作者:ourclaw.cn

更新时间:2026 年 2 月

系列文章第 2 篇:20 个真实工作流拆解

写在前面

上一篇文章《为什么我选择 OpenClaw?》发布后,很多朋友问:"具体怎么用?能不能给个详细的教程?"

好,这篇就是。

我要分享的是我用 OpenClaw 搭建的第一个工作流——每日晨间简报。这也是我推荐所有新手第一个尝试的自动化任务。

为什么推荐先做它:

- 设置简单,30 分钟就能跑通

- 效果立竿见影,每天早上就能看到成果

- 安全(只读操作,不会误删数据)

- 培养使用习惯

我的使用效果:

- 每天节省 20-30 分钟刷资讯的时间

- 已经积累了 47 个视频创意(来自推文的灵感)

- 不再错过重要行业动态

一、这个工作流解决什么问题

1.1 之前的痛苦

每天早上想看科技资讯,我的流程是:

- 打开 Twitter/X

- 手动滚动时间线

- 被各种无关内容分散注意力

- 看到有价值的内容,复制链接

- 打开笔记软件,粘贴保存

- 发现 30 分钟过去了,咖啡都凉了

问题:

- 时间碎片化,效率低

- 容易分心(本来只想看 5 分钟,结果刷了 30 分钟)

- 手动保存麻烦,经常看完就忘

1.2 自动化后的体验

现在每天早上 7:00:

- 手机收到 Discord 推送(简报已生成)

- 花 2 分钟看完结构化摘要

- 有价值的内容已经自动保存到笔记库

- 继续喝咖啡,准备开始一天的工作

关键改变:

- 从"主动搜索"变成"被动接收"

- 从"无序浏览"变成"结构化阅读"

- 从"看完就忘"变成"自动归档"

二、具体实现方案

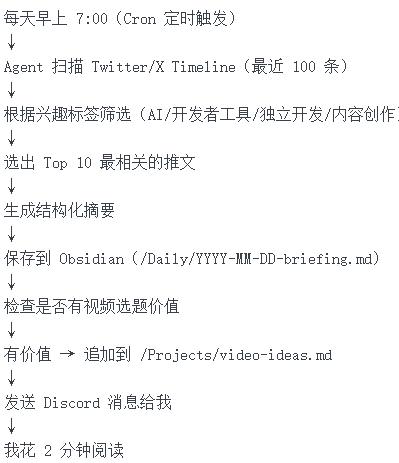

2.1 工作流程图

2.2 关键技术点

数据源:

- Twitter/X API(需要申请开发者账号)

- 或者使用 RSS 源(不需要 API)

筛选逻辑:

- 关键词匹配(AI、开发者工具、独立开发等)

- 互动数据权重(点赞/转发高的优先)

- 去重(避免重复内容)

输出格式:

- Markdown 格式,便于阅读

- 分章节:Top Stories / Interesting Threads / Video Ideas / Quick Hits

- 包含原文链接,方便追溯

三、我实际使用的 Prompt(可直接复制)

3.1 基础版本(推荐新手先用这个)

Set up a daily morning briefing that runs at 7:00am every day.

Here's what it should do:

- Scan my Twitter/X timeline - the last ~100 tweets from accounts I follow

- Pick the top 10 most relevant tweets based on my interests (AI, developer tools, indie hacking, content creation, tech business)

- Write a structured summary to my Obsidian vault at the path: /Daily/YYYY-MM-DD-briefing.md

- If any tweet connects to a potential YouTube video idea, append it to my video ideas backlog at: /Projects/video-ideas.md

- Send me a summary in this channel with the key highlights and any action items

Format the summary with sections: Top Stories, Interesting Threads, Video Ideas (if any), and Quick Hits for everything else.

Keep the tone concise. I want to read this in 2 minutes over coffee, not 10.

3.2 进阶版本(优化后)

这是我现在用的优化版,解决了初期遇到的几个问题:

Set up a daily morning briefing that runs at 7:00am every day.

Here's what it should do:

STEP 1 - Fetch (efficiently):

- Get the last 100 tweets from my timeline using the Twitter API

- ONLY fetch metadata first (author, timestamp, engagement stats, URL)

- Do NOT fetch full text yet (save tokens)

STEP 2 - Filter (smart):

- Score each tweet based on:

- Relevance to topics: AI, developer tools, indie hacking, content creation, tech business (weight: 40%)

- Engagement level (likes + retweets) (weight: 30%)

- Source credibility (verified accounts get slight boost) (weight: 20%)

- Recency (favor tweets from last 12 hours) (weight: 10%)

- Pick top 15 candidates

STEP 3 - Deep read (only top 15):

- Now fetch full text and thread context for the 15 candidates

- Re-score based on actual content quality

- Final selection: top 10

STEP 4 - Generate summary:

- Format as markdown with these sections:

- Top Stories (2-3 items with 2-sentence summary each)

- Interesting Threads (1-2 thread summaries)

- Video Ideas (if any tweet sparks video ideas, list them with angle suggestions)

- Quick Hits (remaining items as bullet points with one-liners)

STEP 5 - Save and notify:

- Save to /Daily/YYYY-MM-DD-briefing.md in Obsidian

- If video ideas found, append to /Projects/video-ideas.md with format: "- [DATE] [TOPIC] - [ANGLE_SUGGESTION] - [SOURCE_URL]"

- Send Discord message with summary and links

- Include reading time estimate

Style guide:

- Use bold for key terms

- Use emojis for section headers (📰 🧵 💡 ⚡)

- Keep total length under 500 words

- Always include source URLs

四、踩过的坑 & 解决方案

坑 1:API 费用失控(第 1 周)

问题: 一开始我让 Agent 直接读完整推文内容,然后筛选。结果每天 Token 消耗巨大,一个月账单 $40+。

原因: 100 条推文 × 每条平均 500 字 = 50,000 字/天,全部要过 LLM。

解决: 改成两段式处理:

- 先读元数据(作者、时间、互动数、URL)→ 快速筛选

- 只让 Top 15 进第二轮深度阅读

效果: Token 消耗减少 70%,费用从 $40/月降到 $12/月。

坑 2:筛选质量差(第 2 周)

问题: Agent 经常选一些互动很高但内容很水的推文(比如吐槽、梗图)。

原因: 只看关键词匹配,没有理解内容质量。

解决: 加入互动质量权重:

• 高互动 + 技术关键词 = 高权重 • 高互动 + 纯情绪表达 = 低权重

同时加入来源可信度:

• 技术大牛的推文权重更高 • 营销号权重降低

坑 3:重复内容(第 3 周)

问题: 同一个话题的多个推文都入选,导致简报内容重复。

原因: 没有做话题聚类。

解决: 增加去重逻辑:

• 相似度检测(如果 3 条推文说的是同一件事,只选互动最高的那条) • 话题标签聚类

坑 4:通知方式不合适(第 1 天)

问题: 一开始让 Agent 发邮件,结果邮件太多被淹没,经常看不到。

解决: 改成 Discord 私信,和其他 OpenClaw 通知集中管理。

现在手机锁屏就能看到简报推送,点开即读。

五、成本分析

5.1 费用明细

| 项目 | 优化前 | 优化后 | 节省 |

|---|---|---|---|

| API 调用(Claude) | $40/月 | $12/月 | 70% |

| Twitter API | $0(免费额度) | $0 | - |

| 服务器资源 | 包含在 OpenClaw 中 | 包含 | - |

| 总计 | $40/月 | $12/月 | $28/月 |

5.2 时间收益

| 指标 | 之前 | 现在 |

|---|---|---|

| 每天刷资讯时间 | 30-45 分钟 | 2 分钟 |

| 每周节省 | ~3.5 小时 | - |

| 每月节省 | ~15 小时 | - |

ROI 计算:

• 投入:$12/月 • 产出:节省 15 小时/月 • 按 $20/小时计算,价值 $300/月 • 净收益:$288/月,ROI 2400%

六、实际效果展示

6.1 简报示例(节选)

📰 晨间简报 - 2026-02-28

Top Stories

OpenClaw 发布新功能:Sub-agents 支持嵌套 现在可以 spawn 的子 Agent 再 spawn 自己的子 Agent,实现真正的层级任务分解。这对复杂研究任务很有用。 → [链接]

Anthropic 推出 Claude 4.5,写作能力提升明显 实测长文本生成更连贯,但价格也更贵了。是否升级需要权衡。 → [链接]

Interesting Threads

@velvet_shark 分享了 OpenClaw 50 天使用经验,包含 20 个工作流的详细 Prompt。这是目前最完整的实战案例。 → [链接]

💡 Video Ideas

- "OpenClaw 新手常见 5 个错误及解决"(从推文讨论中提取的痛点)

- "Claude 4.5 深度评测:值得升级吗?"

⚡ Quick Hits

- Google 发布新模型,实测效果一般...

- 某知名开发者工具宣布涨价...

- ...

生成时间:7:02 AM | 阅读时间:2 分钟 | 共 10 条

6.2 长期价值

使用 50 天后:

• 积累了 47 个视频创意(来自推文的灵感) • 发现了 3 个潜在合作项目(通过行业动态) • 没有错过任何重要技术更新

七、给你的启动建议

7.1 新手配置清单

第一步:准备 API 密钥

• Twitter/X Developer Account(申请免费) • 获取 API Key 和 Access Token

第二步:配置 OpenClaw

• 安装 Twitter Skill(从 ClawHub) • 配置 API 密钥到环境变量 • 测试连接是否正常

第三步:设置 Cron

• 创建定时任务(每天早上 7:00) • 粘贴 Prompt • 测试运行一次

第四步:观察优化

• 运行 3 天,观察内容质量 • 调整兴趣关键词 • 优化筛选权重

7.2 常见问题

Q: 没有 Twitter API 怎么办? A: 可以用 RSS 源替代,或者先用 Reddit/Hacker News 的 API 练手。

Q: 不想用 Obsidian,用其他笔记软件可以吗? A: 可以,修改保存路径即可。支持 Notion、Logseq、甚至本地 Markdown 文件。

Q: 能不能改成晚上发而不是早上? A: 当然可以,修改 Cron 时间即可。有人喜欢在睡前看第二天的资讯。

八、下一篇预告

第 3 篇:《用 OpenClaw 生成"历史时刻前 10 秒"艺术图,每天自动推送到电子墨水屏》

这是一个创意型自动化案例:

• 每天早上生成一张历史事件的艺术图 • 不画事件本身,画事件发生前 10 秒 • 推送到电子墨水屏显示器 • 成本只要 $0.10/天

适合想要生活仪式感的朋友。

如果你跟着这篇教程搭建成功了,欢迎在评论区留言分享你的体验!

有任何问题也可以在评论区留言,我会回复。

本文是"OpenClaw 20 个真实工作流"系列第 2 篇。 系列文章持续更新中,收藏本站 ourclaw.cn 获取最新内容。 最后更新时间:2026 年 2 月